Expo

ver canal

ver canal

ver canal

ver canal

ver canal

ver canal

Imagenología

Cuidados CriticosTéc. QuirúrgicaCuidados de PacientesTIPruebas POCNegocios

Eventos

Webinars

- Interfaz de médula espinal restaura el control de la vejiga en estudio preclínico

- Sistema de control magnético permite la navegación precisa de dispositivos médicos miniaturizados

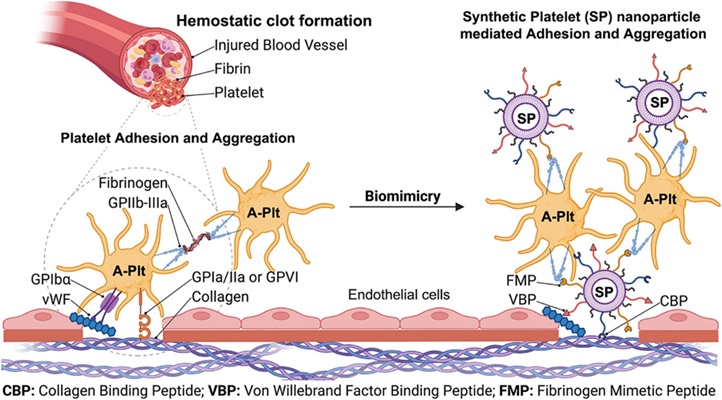

- Plaquetas sintéticas estables a temperatura ambiente podrían permitir el control prehospitalario de hemorragias

- Dispositivo de filtración sanguínea podría prolongar el embarazo en la preeclampsia temprana grave

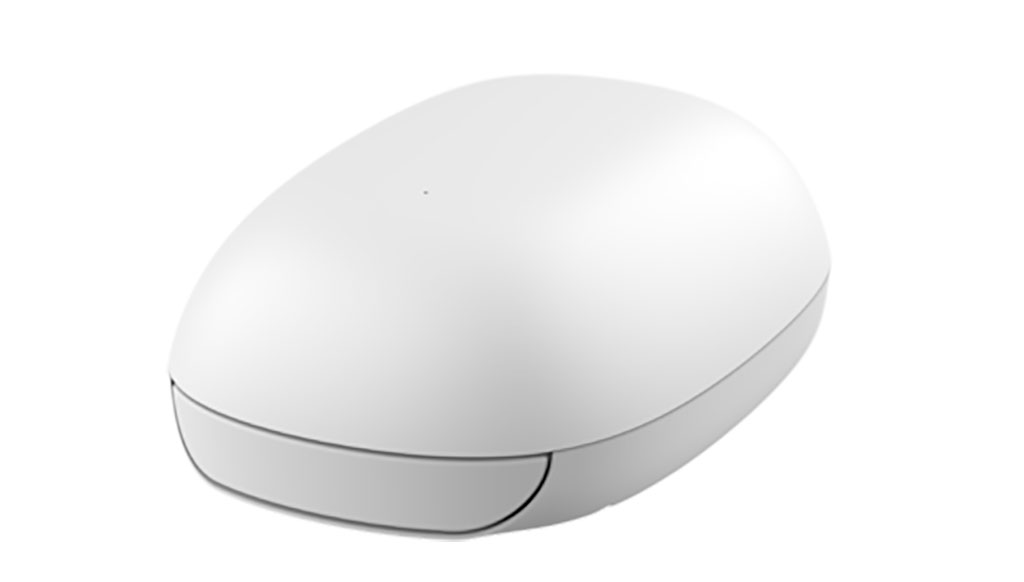

- Sensor craneal no invasivo detecta el deterioro temprano en lesiones cerebrales agudas

- Nueva herramienta de IA predice complicaciones antes de la cirugía de cáncer de pulmón

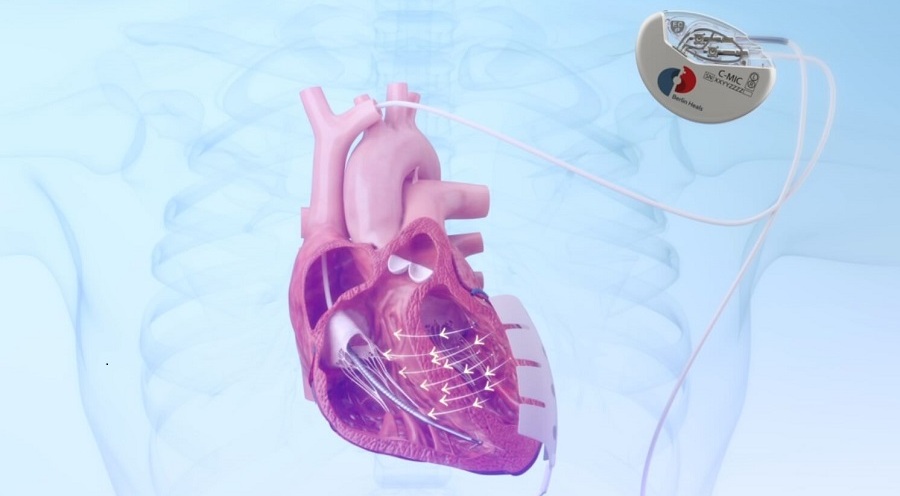

- Dispositivo cardíaco de microcorriente menos invasivo mejora los resultados en insuficiencia cardíaca

- El trasplante parcial de corazón permite el reemplazo de válvulas con capacidad de crecimiento en niños

- Cirugía temprana de “entrenamiento cardíaco” promueve la regeneración en la insuficiencia cardíaca pediátrica

- Implante inteligente para fracturas monitoriza la curación y proporciona soporte adaptativo

- Dispositivo automático de lavado de vías intravenosas mejora la atención en infusiones

- Herramienta de capacitación en realidad virtual combate la contaminación de equipos médicos portátiles

- Plataforma de biosensores portátiles reducirá infecciones adquiridas en el hospital

- Tecnología portátil de luz germicida, única en su tipo, desinfecta superficies clínicas de alto contacto en segundos

- Solución de optimización de la capacidad quirúrgica ayuda a hospitales a impulsar utilización de quirófanos

- Sinocare presenta soluciones integradas de salud digital basadas en IA en CMEF

- GE HealthCare y Medtronic amplían su alianza con la integración de imágenes intraoperatorias.

- GE HealthCare lidera una importante iniciativa europea para impulsar la atención cardio-oncológica

- Philips y Masimo se asocian para impulsar las tecnologías de monitorización de pacientes

- B. Braun adquiere la empresa de microcirugía digital True Digital Surgery

- Herramienta basada en HCE predice el fallo del injerto tras un trasplante de riñón

- Nanopartículas imprimibles permiten la producción masiva de biosensores portátiles

- Los relojes inteligentes podrían detectar la insuficiencia cardíaca congestiva

- Un parche inteligente versátil combina monitoreo de salud y administración de fármacos

- Modelo de aprendizaje automático mejora predicción del riesgo de mortalidad para pacientes de cirugía cardíaca

- Sistema de hemostasia de sangre total POC de última generación reconoce necesidades específicas de servicios de emergencia y quirófanos

- Laboratorio portátil permitirá identificación de infecciones bacterianas más rápida y económica en el punto de necesidad

- Mercado mundial de pruebas de cabecera será testigo de perspectivas prometedoras en cuidados intensivos

- Mercado mundial de diagnóstico de sepsis impulsado por el aumento de enfermedades adquiridas en hospitales

Expo

Expo

- Interfaz de médula espinal restaura el control de la vejiga en estudio preclínico

- Sistema de control magnético permite la navegación precisa de dispositivos médicos miniaturizados

- Plaquetas sintéticas estables a temperatura ambiente podrían permitir el control prehospitalario de hemorragias

- Dispositivo de filtración sanguínea podría prolongar el embarazo en la preeclampsia temprana grave

- Sensor craneal no invasivo detecta el deterioro temprano en lesiones cerebrales agudas

- Nueva herramienta de IA predice complicaciones antes de la cirugía de cáncer de pulmón

- Dispositivo cardíaco de microcorriente menos invasivo mejora los resultados en insuficiencia cardíaca

- El trasplante parcial de corazón permite el reemplazo de válvulas con capacidad de crecimiento en niños

- Cirugía temprana de “entrenamiento cardíaco” promueve la regeneración en la insuficiencia cardíaca pediátrica

- Implante inteligente para fracturas monitoriza la curación y proporciona soporte adaptativo

- Dispositivo automático de lavado de vías intravenosas mejora la atención en infusiones

- Herramienta de capacitación en realidad virtual combate la contaminación de equipos médicos portátiles

- Plataforma de biosensores portátiles reducirá infecciones adquiridas en el hospital

- Tecnología portátil de luz germicida, única en su tipo, desinfecta superficies clínicas de alto contacto en segundos

- Solución de optimización de la capacidad quirúrgica ayuda a hospitales a impulsar utilización de quirófanos

- Sinocare presenta soluciones integradas de salud digital basadas en IA en CMEF

- GE HealthCare y Medtronic amplían su alianza con la integración de imágenes intraoperatorias.

- GE HealthCare lidera una importante iniciativa europea para impulsar la atención cardio-oncológica

- Philips y Masimo se asocian para impulsar las tecnologías de monitorización de pacientes

- B. Braun adquiere la empresa de microcirugía digital True Digital Surgery

- Herramienta basada en HCE predice el fallo del injerto tras un trasplante de riñón

- Nanopartículas imprimibles permiten la producción masiva de biosensores portátiles

- Los relojes inteligentes podrían detectar la insuficiencia cardíaca congestiva

- Un parche inteligente versátil combina monitoreo de salud y administración de fármacos

- Modelo de aprendizaje automático mejora predicción del riesgo de mortalidad para pacientes de cirugía cardíaca

- China aprueba la primera vacuna inhalable contra la COVID-19 del mundo

- Vacuna en parche contra la COVID-19 combate variantes del SARS-CoV-2 mejor que las agujas

- Pruebas de viscosidad sanguínea predicen riesgo de muerte en pacientes hospitalizados con COVID-19

- ‘Computadora Covid’ usa IA para detectar COVID-19 en exámenes de TC de tórax

- Técnica de resonancia magnética muestra la causa de los síntomas de COVID prolongada

- Sistema de hemostasia de sangre total POC de última generación reconoce necesidades específicas de servicios de emergencia y quirófanos

- Laboratorio portátil permitirá identificación de infecciones bacterianas más rápida y económica en el punto de necesidad

- Mercado mundial de pruebas de cabecera será testigo de perspectivas prometedoras en cuidados intensivos

- Mercado mundial de diagnóstico de sepsis impulsado por el aumento de enfermedades adquiridas en hospitales